Artificial Intelligence (AI)

Προοίμιο

Η λεγόμενη Τεχνητή Νοημοσύνη, αν και εμφανίστηκε στο προσκήνιο ήδη από την δεκαετία του ‘50, αρχικά δεν απασχόλησε με εκτεταμένες συζητήσεις την κοινωνία, αλλά περιορίστηκε σε μικρές κλειστές ομάδες ειδικών. Την κοινωνία προϊδέαζαν κάποια δευτεροκλασάτα περιοδικά με ιστοριούλες, διηγήματα επιστημονικής φαντασίας και λίγο αργότερα ταινίες του Χόλυγουντ και άλλων Στούντιο.

Φτάσαμε 70 και 80 χρόνια μετά για να απασχολήσει το θέμα τον γενικό πληθυσμό, κυρίως με ευθύνη των ΜΜΕ και η ΤΝ να αποτελέσει πολιτικό διακύβευμα για το οποίο να διαγκωνίζονται πολιτικοί και κόμματα, αλλά και άλλοι διάφοροι, ειδικοί και μη, για να προκαλέσουν την προσοχή του κοινού. Όταν τους βλέπω να φουσκώνουν σαν τα παγόνια στην τηλεόραση και αλλού, εκφέροντας μεγαλοστομίες, μου έρχεται στο νου το σύγγραμμα του Yudkowsky (1) που ήδη από το 2008, υποστηρίζει, όχι αδίκως, ότι το κύριο πρόβλημα με την ΤΝ είναι ότι οι άνθρωποι γενικά πιστεύουν ότι γνωρίζουν και καταλαβαίνουν τα της ΤΝ, πολύ περισσότερο απ’ ότι αυτό συμβαίνει στην πραγματικότητα!

Σήμερα, το θέμα καλύπτεται στο δημόσιο βήμα από μία αχλύ μυστηρίου και μύθου, με κάποιους “ειδικούς” να ευαγγελίζονται σπουδαία πράγματα για το μέλλον αν ακολουθήσουμε την αρχηγία τους, ή τρομακτικές καταστροφές αν δεν προλάβουμε να “πηδήξουμε στο τρένο”, έχοντας γραμμένη στα παλιά τους παπούτσια την αρετή της “μεσότητας” του Αριστοτέλη!

Το ερώτημα όμως που, μέσα σ’ αυτόν τον θόρυβο, γεννιέται στον μέσο άνθρωπο είναι, “τί ακριβώς είναι αυτή η περίφημη ΤΝ, πού μπορεί να μας βοηθήσει, καθώς και, αν και τί πρέπει να φοβόμαστε από αυτήν”;

Ένα ΠΟΛΥ μικρό ιστορικό

Όταν άρχισαν να κατασκευάζονται οι πρώτοι υπολογιστές, ΔΕΝ είχαν λογισμικό (software, προγράμματα). Το υλικό τους (hardware) είχε τέτοια αρχιτεκτονική που εκτελούσε πράξεις, λογικές και αριθμητικές, με συγκεκριμένη σειρά και με συγκεκριμένο στόχο. Τα δεδομένα αποθηκεύονταν και διακινούνταν σε μνήμες “εφήμερες”, όπου μπορούσαν να εγγραφούν και να διαγραφούν εύκολα. Οι υπολογιστές αυτοί, χρησιμοποιήθηκαν και χρησιμοποιούνται ακόμη σε περιπτώσεις που η ταχύτητα είναι πρωταρχική παράμετρος και η εργασία συγκεκριμένη. Τέτοιες περιπτώσεις βρίσκονται ακόμη (με μικρές βελτιώσεις) σε κάποια οπλικά συστήματα και κάποια συστήματα επιστημονικών μετρήσεων και λειτουργούν συχνά χωρίς να γίνονται αντιληπτοί από τους χειριστές των συστημάτων και μάλιστα χωρίς πια να θεωρούνται “υπολογιστές”.

(Σημείωση : Η έννοια της αρχιτεκτονικής στο παρόν κείμενο, εδώ και στην συνέχεια, αναφέρεται στον τρόπο διασύνδεσης των κυκλωμάτων μεταξύ τους. Παρόμοια έννοια, η δομή).

Λίγο αργότερα κατασκευάστηκαν οι υπολογιστές που σήμερα ακόμη βρίσκονται σε ευρεία χρήση και είναι γνωστοί σε όλους μας. Οι υπολογιστές αυτοί είναι κατά κάποιαν έννοια “γενικής χρήσεως”, δηλαδή μπορούν να κάνουν πολλές διαφορετικές εργασίες και καλύπτουν μεγάλη γκάμα δραστηριοτήτων, ανάλογα με τις ανάγκες του καθενός. Χρησιμοποιούν “λογισμικό” (software), ή αλλιώς προγράμματα, εγγεγραμμένα και αυτά με την σειρά τους σε εφήμερες μνήμες και εκτελούν εργασίες πάνω σε δεδομένα που επίσης είναι εγγεγραμμένα σε παρόμοιες μνήμες. Τα υπόψη προγράμματα απ’ ότι ξέρει ο καθένας μας μπορούμε να τα σβήσουμε και να τοποθετήσουμε άλλα, διαφορετικά, ή και να επιτρέψουμε την ενημέρωσή τους, από την Google ή άλλον κατασκευαστή, που πραγματοποιείται σε άτακτα χρονικά διαστήματα με σκοπό να βελτιώσουν την ασφάλεια ή να διορθώσουν και να προσθέσουν κάποιες λειτουργίες. Ένα κεντρικό πρόγραμμα κανονίζει τις λειτουργίες των υπολοίπων προγραμμάτων (πώς, τί, πότε), όπως ο διευθυντής μιάς ορχήστρας. Το πρόγραμμα αυτό είναι ήδη τοποθετημένο στον υπολογιστή σας, για παράδειγμα, όταν τον προμηθευόσαστε από τον κατασκευαστή. Η νέα γενιά υπολογιστών μας έδωσε μεγάλη ευελιξία, ευελιξία που πλέον την χρησιμοποιούμε για εργασίες που μέχρι χτες ήταν αδιανόητες, πληρώνοντας ένα μικρό κόστος στην ταχύτητα, πράγμα που έτσι κι αλλιώς καλύφθηκε από την εξέλιξη της τεχνολογίας (ταχύτερες και μεγαλύτερες μνήμες).

Καθώς τα πράγματα με τον προγραμματισμό των υπολογιστών γίνονταν όλο και πιό πολύπλοκα, οι μηχανικοί έκαναν μια σκέψη που αναδύθηκε φυσιολογικά σχεδόν : Γιατί να μην επινοήσουμε έναν υπολογιστή που να ΤΡΟΠΟΠΟΙΕΙ ΜΟΝΟΣ ΤΟΥ τα προγράμματά του, ανάλογα με την εργασία που του ανατίθεται; Ένας τρόπος για να γίνει αυτό είναι η σχεδίαση μιας αρχιτεκτονικής με πολλαπλά “υπολογιστικά” στρώματα, όπου ένα στρώμα λειτουργεί σαν υπολογιστής που ενεργεί σε ένα άλλο στρώμα, χρησιμοποιώντας τα προγράμματα του δεύτερου στρώματος σαν δικά του δεδομένα και τροποποιώντας τα, και ούτω καθ’ εξής. Αυτό το νέο είδος υπολογιστού, που μπορεί να τροποποιεί μόνος του τα προγράμματά του, είναι αυτό που ονομάζουμε “Τεχνητή Νοημοσύνη” (ή ΤΝ σε συντομογραφία). Οι υπολογιστές αυτοί μπορούν να “μαθαίνουν” μόνοι τους (Μηχανική Μάθηση) και να αναπτύσσουν ικανότητες με την καθοδήγηση του προγραμματιστού ή του χειριστού τους. Αυτή η ευελιξία είναι που κάνει τους νέους αυτούς υπολογιστές να εκτελούν λειτουργίες που φαίνονται στον έξω κόσμο σαν να είναι το προϊόν ενός είδους λογικής σκέψης.

Ορισμός – Είδη

Ο όρος τεχνητή νοημοσύνη (ΤΝ) αναφέρεται λοιπόν στην ανάπτυξη υπολογιστικών συστημάτων και προγραμμάτων ικανών να εκτελούν νοητικές εργασίες που απαιτούσαν ιστορικά την ανθρώπινη νοημοσύνη, όπως η αναγνώριση της ομιλίας, η λήψη αποφάσεων και η αναγνώριση τάσεων, στην κοινωνία και αλλού.

Ένας λεπτομερέστερος ορισμός, σύμφωνα με την Εκτελεστική Διαταγή ΕΟ 13960 (2) του Προέδρου των Ηνωμένων Πολιτειών της Αμερικής, σε ελεύθερη μετάφραση, παρακάτω : (Αν δεν είσαστε εξοικειωμένοι με την νομική ορολογία, θα το βρείτε λίγο κουραστικό! Αλλά διαβάζοντάς το, η συζήτηση στις επόμενες παραγράφους θα σας φανεί περισσότερο κατανοητή).

“Τεχνητή Νοημοσύνη νοείται

- Κάθε τεχνητό σύστημα που επιτελεί έργο υπό μεταβαλλόμενες και απρόβλεπτες συνθήκες, χωρίς ουσιαστική ανθρώπινη επίβλεψη, ή που μπορεί να μάθει εμπειρικά και να βελτιώσει την λειτουργικότητά του όταν εκτεθεί σε σύνολα στοιχείων.

- Ένα τεχνητό σύστημα αναπτυγμένο σε λογισμικό, φυσικό υλικό, ή άλλη κατηγορία, που επιτελεί καθήκοντα που απαιτούν ανθρώπινη αντίληψη, κατανόηση, σχεδίαση, μάθηση, επικοινωνία ή φυσική αντίδραση.

- Ένα τεχνητό σύστημα σχεδιασμένο να σκέπτεται ή να ενεργεί σαν άνθρωπος, συμπεριλαμβανομένων διανοητικών αρχιτεκτονικών και νευρικών κυκλωμάτων.

- Ένα σύνολο τεχνικών, περιλαμβανομένης της μηχανικής μάθησης, σχεδιασμένο να προσομοιάζει ένα διανοητικό καθήκον.

- Ένα τεχνητό σύστημα σχεδιασμένο να αντιδρά λογικά, συμπεριλαμβανομένου ενός έξυπνου λογισμικού υποκειμένου ή ενσωματωμένου σε ρομπότ που επιτυγχάνει στόχους, χρησιμοποιώντας αντίληψη, σχεδιασμό, συλλογιστική, μάθηση, επικοινωνία, λήψη απόφασης και δράση.”

Κοντολογίς, η ΤΝ είναι η κατάληξη της προσπάθειας του ανθρώπου να κάνει τη ζωή του πιό εύκολη, μέχρι χτες αντικαθιστώντας την μυϊκή δύναμη και τώρα πιά αντικαθιστώντας ακόμη και τις νοητικές του λειτουργίες με μηχανικά υποκατάστατα, είτε σαν μέρος υπολογιστικών συστημάτων, είτε ενσωματωμένα σε εξειδικευμένα ή και ανεξάρτητα μηχανικά συστήματα (ρομπότ).

Στην έρευνα και ανάπτυξη των συστημάτων αυτών, κάποιες κατευθύνσεις έχουν διακριθεί και αναπτυχθεί περισσότερο από άλλες. Μερικές από τις προσεγγίσεις αυτές είναι (3) :

- Υποστήριξη στην Λήψη Αποφάσεων. Ειδικά εργαλεία έχουν αναπτυχθεί για να αντιμετωπισθούν περίπλοκες διαδικασίες. Συγκεκριμένα, εξετάζονται πολλαπλές λύσεις δράσεως, με μεταβαλλόμενες παραμέτρους και υπολογίζονται τα αποτελέσματα στη βάση της θεωρίας των πιθανοτήτων. Οι λύσεις παρουσιάζονται στον υπεύθυνο για την απόφαση, ο οποίος και τελικά αποφασίζει ποιός δρόμος θα ακολουθηθεί. (4)

- Βαθεία Μάθηση. Είναι μιά υποκατηγορία της λεγόμενης γενικότερα “μηχανικής μάθησης” που περιλαμβάνει νευρικά κυκλώματα πολλαπλών στρωμάτων (τουλάχιστον τεσσάρων) όπως έθιξα στην αρχή. Διαφέρει από τα άλλα είδη μηχανικής μάθησης επειδή έχει την ικανότητα, αυτόματα, να ανακαλύπτει χαρακτηριστικά από σκόρπια στοιχεία και να βελτιστοποιεί αλγορίθμους (5). Οι πιο κοινές εφαρμογές είναι στα έμπειρα συστήματα και τα προγράμματα εξόρυξης δεδομένων. (6)

- Τεχνητά Νευρωνικά Δίκτυα. Είναι η μέθοδος για την εκπαίδευση υπολογιστών στην επεξεργασία δεδομένων, με αρχιτεκτονική εμπνευσμένη από τις νευρικές συνδέσεις του ανθρώπινου μυαλού, μέσω μιας πολυεπίπεδης, δικτυωμένης δομής νευρικών κυκλωμάτων. Στην συγκεκριμένη περίπτωση, δεν είναι τα προγράμματα που τροποποιούνται, αλλά η συχνότητα χρήσης των συνδέσεων μεταξύ των κυκλωμάτων, με την βοήθεια της πιθανοθεωρίας (σταθμισμένα μονοπάτια απόφασης).

- Μηχανική Αντίληψη. Μπορεί να είναι υποκατηγορία των Νευρωνικών Δικτύων ή της Βαθείας Μάθησης. Επί μέρους υποκατηγορίες, η κατανόηση ομιλίας, η αναγνώριση εικόνας (συμπεριλαμβανομένης της κατάταξης εικόνων, της αναγνώρισης προσώπων και αντικειμένων), της παρακολούθησης προσώπων ή αντικειμένων και της ρομποτικής αντίληψης. (8)

- Επεξεργασία Φυσικής Γλώσσας. Άλλη μία υποκατηγορία της “μηχανικής μάθησης” είναι η εκπαίδευση υπολογιστών στο να καταλαβαίνουν, να ερμηνεύουν και να χειρίζονται τις ανθρώπινες γλώσσες. (6)

- Ρομποτικός Έλεγχος. Χρησιμοποιείται η ρομποτική αντίληψη που περιλαμβάνει και αίσθηση αφής και θέσης στον χώρο, αλλά και έλεγχο με σερβομηχανισμούς της κίνησης των μελών του ρομπότ ή και της κίνησής του στον χώρο.

- Γενική Τεχνητή Νοημοσύνη. Φιλόδοξο πρόγραμμα. Επιδιώκεται η κατασκευή μιάς μηχανής Γενικής Τεχνητής Νοημοσύνης η οποία να μπορεί να επιλύει μια μεγάλη γκάμα προβλημάτων, με εύρος και ευελιξία παρόμοια με εκείνη της ανθρώπινης νοημοσύνης.

Τί μπορεί να κάνει η ΤΝ

Με βάση τα παραπάνω, η ΤΝ, μπορεί να εκτελεί διάφορες εργασίες, χρησιμοποιώντας τον τεράστιο όγκο δεδομένων του Παγκόσμιου Ιστού (εφόσον είναι συνδεδεμένη) ή “μαθαίνοντας” και εφαρμόζοντας ικανότητες, με καθοδήγηση του “χειριστού” (ή “εκπαιδευτού”) της, όπως :

- Να γράψει τις ιστορίες, εργασίες και τα δοκίμιά σας, ή οτιδήποτε άλλο φανταστείτε. Αυτά δεν θα γραφτούν τελείως αυτόματα, αλλά θα πρέπει να καθοδηγήσετε το πρόγραμμα τί να κάνει, όσον αφορά πχ το σκοπό του εγγράφου, το στυλ, αν θα έχει βιβλιογραφία ή όχι, ποιά βιβλιογραφία να χρησιμοποιήσει, τον σκελετό του εγγράφου, κλπ. Αν αμφιβάλετε, ρωτήστε πχ, το ChatGPT (ή το Κινέζικο R1 της DeepSeek, πιό αργό αλλά και πιό ουσιαστικό, ή και το Qwen2.5 της Alibaba!) και θα σας πει αυτό τί χρειάζεται!

- Να “δημιουργήσει” έργα τέχνης. Πρέπει και εδώ να την καθοδηγήσετε τί να κάνει. Βλέπετε η ΤΝ δεν έχει φαντασία. Μπορεί να κατασκευάσει ένα έργο χρησιμοποιώντας την τεράστια αποθήκη πληροφοριών του παγκόσμιου ιστού και να συνδυάσει διάφορα στοιχεία. Αλλά πρέπει να την καθοδηγήσετε εσείς, τί να κάνει και πως πρέπει να το κάνει.

- Να “μάθει” και να “εκπαιδευτεί”. Τα περισσότερα ρομπότ για παράδειγμα, που βλέπουμε να αναπτύσσονται από διάφορες εταιρείες, εκπαιδεύονται πως να κινούνται και να εκτελούν διάφορες εργασίες. Δεν είναι κατασκευασμένα εξ αρχής, ώστε να λειτουργούν και να χρησιμοποιούν όλες τους τις δυνατότητες. Αυτή είναι η ομορφιά αυτής της τεχνολογίας. Το Ρομπότ μπορεί τελικά να μάθει να κάνει πράγματα με το “σώμα” του, που ο κατασκευαστής του, ούτε που τα είχε φανταστεί.

- Να μάθει να προβλέπει τις τάσεις της αγοράς παρακολουθώντας σε πραγματικό χρόνο τις αγοραπωλησίες, να ενημερώνει τον χειριστή για το αποτέλεσμα και να προτείνει επενδύσεις με βάση τις πιθανότητες. Τα περισσότερα οικονομικά επιτελεία και τα χρηματοπιστωτικά ιδρύματα σήμερα, χρησιμοποιούν την ΤΝ για να προβλέψουν τις οικονομικές τάσεις και να κάνουν επενδύσεις, καθώς ο όγκος των δεδομένων είναι κυριολεκτικά τεράστιος.

- Να συλλέγει στοιχεία βλαβών και αποτελεσματικότητας τεχνολογικών συστημάτων που ήδη έχουν αποθηκευθεί στον παγκόσμιο ιστό ή στην μνήμη ενός ιδιωτικού συστήματος υπολογιστών, να τα αναλύει στατιστικά, προβλέποντας τάσεις και υπολογίζοντας χρόνους αντικατάστασης υλικών και εξαρτημάτων ή να κάνει προτάσεις βελτίωσης της αποτελεσματικότητας με βάση στόχους που θα του έχουν τεθεί από τον χειριστή.

- Να μάθει να αναλύει τάσεις για την προώθηση προϊόντων, χρησιμοποιώντας τις τηλεφωνικές κλήσεις μιας εταιρείας και καταγράφοντας την επιτυχία των διαφόρων μεθόδων και στην συνέχεια να προτείνει διαφημιστικές στρατηγικές για κάθε προϊόν, βασισμένες στην επιτυχία των κλήσεων.

- Να βοηθήσει γιατρούς και νοσοκομεία στην διάγνωση και θεραπεία ασθενειών και να διακρίνει νέες πιθανές θεραπείες.

- Να μεταφράσει γλώσσες σε πραγματικό χρόνο. Φανταστείτε ότι θα μπορείτε να μιλάτε, με έναν Κινέζο, για παράδειγμα, χωρίς κανένας από τους δύο να γνωρίζει την γλώσσα του άλλου και να τον ακούτε να μιλάει στα ελληνικά, με την ίδια την χροιά της πραγματικής φωνής του, αν και αυτός θα μιλάει κινέζικα. (7)

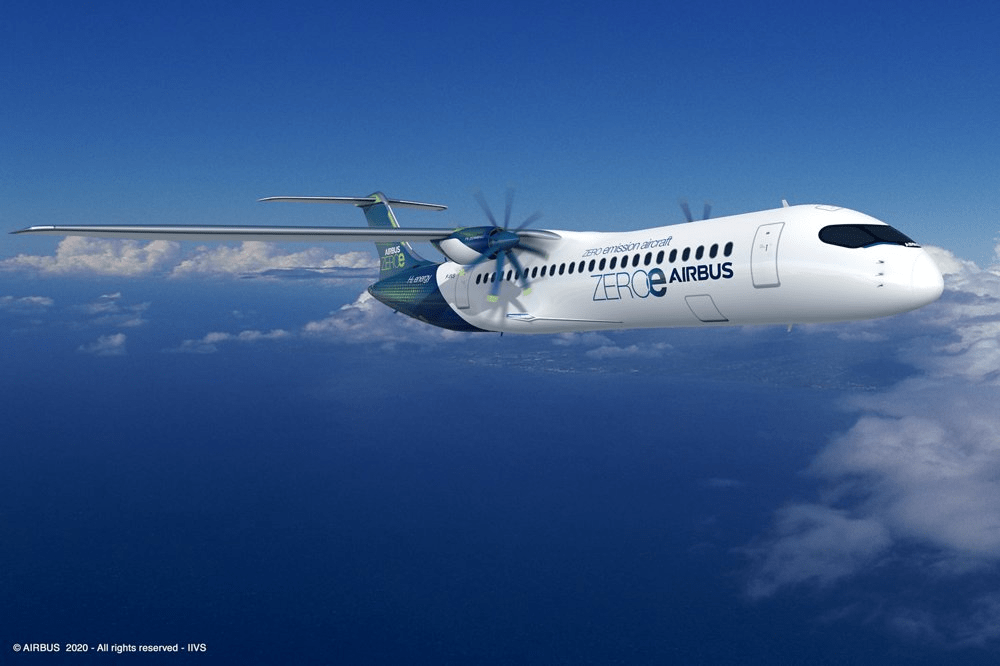

- Να οδηγεί αυτοκαθοδηγούμενα οχήματα, όπως αυτοκίνητα και οχήματα εδάφους γενικά, πλοιάρια και ιπτάμενες μηχανές, συμπεριλαμβανομένων και πολεμικών μηχανών που να μπορούν να εκτελέσουν τακτικές αποστολές, να στοχεύσουν και να αφήσουν όπλα σε καταδεικνυόμενους στόχους, αποφεύγοντας τα εχθρικά πυρά.

- Να βοηθά στην λήψη αποφάσεων σε θέματα στρατηγικής και τακτικής, σε Κέντρα Επιχειρήσεων, χρησιμοποιώντας πολλαπλά μέσα συλλογής ή επιτήρησης και προτείνοντας λύσεις στη βάση ανάλυσης των πιθανοτήτων.

Τί δεν μπορεί να κάνει η ΤΝ

Από τους υψηλούς στόχους που τέθηκαν στην αρχή, πολλοί δεν έχουν ακόμη επιτευχθεί, για κάποιους μάλιστα δεν φαίνεται στον ορίζοντα η πραγματοποίησή τους. Αυτό δεν σημαίνει ότι δεν θα πραγματοποιηθούν ποτέ. Η τεχνολογική πρόοδος δεν μπορεί πάντα να προβλεφθεί καθώς δεν είναι απαραίτητα γραμμική. Μιά μικρή αλλαγή στον τρόπο σκέψης, ή μια τεχνολογική επινόηση μπορεί να φέρει κατακλυσμιαίες εξελίξεις. Ορισμένα από τα πράγματα που η ΤΝ σήμερα δεν μπορεί να κάνει καταγράφονται πιό κάτω :

- Η ΤΝ δεν μπορεί να κάνει ταυτόχρονα πολλές εργασίες (multitasking). Κάποιες προσπάθειες που έχουν γίνει, τελικά καταλήγουν στο σενάριο, ένας άνθρωπος να καθοδηγεί την ΤΝ στο τί να κάνει, με ποιά σειρά. Ας το δούμε αυτό με ένα παράδειγμα : Ένα πρόγραμμα ΤΝ που παρακολουθεί την κίνηση των μετοχών, δεν μπορεί συγχρόνως να προβλέπει τις τάσεις σε μία αγορά μετοχών, να αποφασίζει ποιές μετοχές πρέπει να πουληθούν ή να αγοραστούν και ταυτόχρονα να προσπαθεί να ενημερώσει τηλεφωνικά τον πελάτη που πρέπει να κάνει την κίνηση, ή/και να κάνει τις αγοραπωλησίες από μόνο του.

- Η ΤΝ δεν μπορεί να επινοήσει νεοφυείς διαδικασίες και μηχανισμούς μετρήσεων, ούτε να προβεί σε μετρήσεις και ελέγχους για την βελτίωση της συντήρησης ή της αποτελεσματικότητας ενός τεχνολογικού συστήματος γενικά, αλλά μπορεί να διακρίνει και να παρουσιάσει κάποια κενά που ενδεχομένως υπάρχουν.

- Η ΤΝ δεν μπορεί να εξηγήσει τον συλλογισμό βάσει του οποίου έφτασε σε ένα συμπέρασμα! Ο τρόπος που ενεργεί η ΤΝ είναι πολύπλοκος και δεν είναι κατανοητός από την ίδια την ΤΝ. Μάλιστα, καθώς τα μοντέλα γίνονται πιό πολύπλοκα, τόσο δυσκολότερο γίνεται το εγχείρημα. Γεννώνται λοιπόν τα ερωτήματα, πως μπορούμε να είμαστε σίγουροι ότι η λύση που μας προσφέρει η ΤΝ είναι ορθή, είναι έντιμη, ηθική ή δίκαιη; μπορεί η ΤΝ να μας παραπλανά; (στην τελευταία ερώτηση, πολλοί μηχανικοί πιστεύουν ότι αυτό μπορεί να γίνει και έχει αποδειχτεί ότι το κάνουν οι μηχανές που μαθαίνουν να παίζουν σκάκι! Αυτή είναι εξάλλου η δουλειά τους!) Τέλος, το απλούστερο, πως μπορεί να είμαστε σίγουροι ότι η ΤΝ έφτασε στην σωστή απόφαση και δεν αποφάσισε στην βάση εσφαλμένων στοιχείων; (Garbage in – Garbage out!).

- Η ΤΝ δεν μπορεί να παίρνει ηθικές αποφάσεις γιατί δεν γνωρίζει τί είναι η ηθική, ούτε μπορεί να την καταλάβει. Γιατί για παράδειγμα ένα αυτοκινούμενο όχημα πρέπει να σταματήσει για να αποφύγει να “πατήσει” ένα παιδί που παίζοντας μπάλα βγήκε απότομα στον δρόμο; κι αν είναι σκυλί; κι αν πρέπει να διαλέξει ανάμεσα σε ένα σκυλί και σε ένα παιδί; Πόσο “σφιχτά” πρέπει να κρατάει τους χρόνους που του έχουν δώσει για να εκτελέσει ένα δρομολόγιο και με ποιό ηθικό κόστος; Σε αντίστοιχο πρόγραμμα της IBM, η εταιρεία προσπαθεί να λύσει το πρόβλημα μαθηματικά, δηλαδή να ορισθούν πιθανότητες ανάλογα με το πως μια μεγάλη ομάδα ανθρώπων θα αντιδρούσε σε διάφορες περιπτώσεις! (και τί γίνεται αν εμφανιστεί ένα πρόβλημα που δεν είχε προβλεφθεί, θα ρωτήσετε;).

- Η ΤΝ δεν έχει συναισθήματα. Δεν νοιώθει λύπη, θυμό, αγάπη, φιλία! Δεν μπορεί επομένως να σχηματίσει συναισθηματικούς δεσμούς όπως κάνουν καθημερινά οι άνθρωποι, πράγμα που ένας άνθρωπος το καταλαβαίνει αμέσως! Πόσες φορές δεν έχετε εκνευριστεί συνομιλώντας με μια μηχανή στο τηλέφωνο; Δεν οφείλεται στο ότι δεν είναι αποτελεσματική σε αυτό που κάνει. Σας εκνευρίζει κυρίως γιατί δεν αισθάνεστε συναισθηματική επαφή και προσπαθείτε να την ξεπεράσετε για να μιλήσετε με έναν άνθρωπο. Όμως όπως έγραψα πάρα πάνω η ΤΝ θα παρατηρήσει την συμπεριφορά σας, θα καταγράψει τα συναισθήματα σας για να τα αναλύσει από άποψη marketing και μπορεί να ειδοποιήσει για την συναισθηματική σας κατάσταση τον άνθρωπο στον οποίο θα περάσει το τηλεφώνημα ώστε εκείνος να είναι προετοιμασμένος (συμπέρασμα : αν θέλετε να μιλήσετε με χειριστή, να μην μιλάτε εκνευρισμένα στη μηχανή!).

- Όπως είπα και προηγουμένως, η ΤΝ δεν έχει φαντασία και δημιουργικότητα. Θα επαναλάβω λοιπόν εδώ, ότι ΕΠΙ ΤΟΥ ΠΑΡΟΝΤΟΣ δεν φαίνεται ότι η ΤΝ έχει ή θα έχει αυτήν την ικανότητα, χωρίς την καθοδήγηση ενός ανθρώπου.

- Η ΤΝ δεν έχει αντίληψη για το πως είναι και πώς λειτουργεί ο κόσμος. Δεν έχει την αίσθηση πόσο ζυγίζει ένα πακέτο τσιγάρα πχ, ή αν ένας αναπτήρας είναι πιό βαρύς από ένα στυλό. Ο κόσμος είναι εξαιρετικά περίπλοκος και ένας άνθρωπος μαθαίνει την λειτουργία του ζώντας μέσα στον κόσμο. Η ΤΝ “ζώντας” κλεισμένη μέσα στα κυκλώματα δεν μπορεί να αντιληφθεί καν τί είναι ο κόσμος. Αν σας πεί το βάρος ενός πακέτου τσιγάρων, είναι γιατί βρήκε την συγκεκριμένη πληροφορία μέσα στο διαδίκτυο, όχι γιατί έχει προσωπική αντίληψη. (6)

- Η ΤΝ δεν μπορεί να αντικαταστήσει εντελώς τους ανθρώπους (Γενική ΤΝ). Μπορεί να κάνει κάποιες επαναλαμβανόμενες εργασίες τρομακτικά πιό γρήγορα από τους ανθρώπους. Μπορεί να συλλέξει στοιχεία από το διαδίκτυο με τρόπο που είναι αδύνατος για τον άνθρωπο, να κατατάξει, να αναλύσει, να εκτελέσει μαθηματική ανάλυση και να υπολογίσει πιθανότητες σε μια στιγμή, αλλά τί θα κάνει τα στοιχεία και πως θα τα συνδυάσει με έναν δημιουργικό τρόπο, δεν θα μπορέσει να το κάνει. Η ΤΝ δεν μπορεί να μάθει κάτι και να βελτιώσει την λειτουργία της ανάλογα. Δεν έχει δηλαδή την πλαστικότητα και την ευελιξία που έχουν οι άνθρωποι και είναι ο στόχος της Γενικής ΤΝ (9). Οι άνθρωποι συνεπώς θα απαλλαγούν (κάποιοι ίσως και να μην θέλουν!) από βαρετές, επαναλαμβανόμενες εργασίες, στις οποίες η ΤΝ και θα τους αντικαταστήσει, και γι αυτό, θα πρέπει να ψάξουν για εργασίες πιό δημιουργικές για να αντιμετωπίσουν το πρόβλημα τους.

- Τέλος, κάτι που η ΤΝ δεν θα μπορέσει να αποκτήσει, μάλλον ποτέ, είναι η συνείδηση, καθώς απ’ ότι φαίνεται, ούτε οι άνθρωποι μπορούν να κατανοήσουν τί είναι και πως αναδύεται η συνείδηση (10)! Αυτό πάει χέρι με χέρι με το ένστικτο επιβίωσης, το οποίο, με δυσκολία μεν, αλλά θα μπορούσε να εξομοιωθεί με κάποιον έμμεσο τρόπο, όπως με την περίπτωση της IBM για την ηθική.

Πιθανολογούμενοι Μελλοντικοί Κίνδυνοι από την ΤΝ

Το άγνωστο από αρχαιοτάτων χρόνων, προκαλούσε τον φόβο στους ανθρώπους. Επόμενο λοιπόν ότι οι περισσότεροι έτσι θα αντιμετώπιζαν την ΤΝ : Με σκεπτικισμό και φόβο.

Σε άρθρο τους όμως, από τον Ιούλιο του 2024 στο Built-In, οι Mike Thomas και Matthew Urwin, μας γνωρίζουν ότι, όχι μόνο ο μέσος άνθρωπος, αλλά και αρκετοί ειδικοί έχουν τις αμφιβολίες τους (11). Έτσι, μαθαίνουμε ότι ο Geoffrey Hinton της Google, που έχει αποκτήσει το παρατσούκλι του “Νονού της ΤΝ” για την πρωτοποριακή έρευνά του πάνω στους αλγορίθμους, εγκατέλειψε το 2023 την εταιρεία, γιατί άρχισε να αμφιβάλλει για την εργασία του και ήθελε να μιλήσει ελεύθερα στο κοινό για τους κινδύνους που αναδύονται από την έρευνα αυτή. Επιπλέον, την ίδια χρονιά ο γνωστός μας Elon Musk μαζί με άλλες 1000 περίπου διακεκριμένες στην τεχνολογία αιχμής προσωπικότητες, με ανοιχτή τους επιστολή, ζήτησαν από την κυβέρνηση να σταματήσει προσωρινά την έρευνα στο πεδίο αυτό, μέχρι να μελετηθούν οι κίνδυνοι για τους ανθρώπους και την κοινωνία.

Απ’ ότι είναι γνωστό, η έρευνα όχι μόνο δεν σταμάτησε, αλλά έχει ενταθεί, λόγω και του ανταγωνισμού με την Κίνα. Οι κίνδυνοι πάντως που με τον καιρό έχουν επισημανθεί από διάφορες προσωπικότητες και οργανισμούς, είναι σε περίληψη οι παρακάτω :

- Έλλειψη διαφάνειας στις διαδικασίες. Όπως επισήμανα και στην προηγούμενη παράγραφο (Τί δεν μπορεί να κάνει η ΤΝ), υπάρχει σοβαρό πρόβλημα με την διαφάνεια και την κατανόηση των συλλογισμών βάσει των οποίων μία ΤΝ κατέληξε σε ένα συμπέρασμα. Στην ουσία ακόμη και οι ίδιοι οι μηχανικοί που κατασκεύασαν τις αρχιτεκτονικές της ΤΝ, αδυνατούν να καταλάβουν πως η ΤΝ κατέληξε σε μια ΣΥΓΚΕΚΡΙΜΜΕΝΗ ΑΠΟΦΑΣΗ. Κανείς δεν καταλαβαίνει αν το συμπέρασμα είναι ορθό, έντιμο, ηθικό, δίκαιο, παραπλανητικό ή εσφαλμένο. Η λύση που προτάθηκε είναι η ανακατασκευή των αρχιτεκτονικών ώστε οι αποφάσεις να είναι διαφανείς. Όσο αυτό κι αν φαίνεται προφανές, δεν είναι εύλογο ή εύκολο. Όλες οι αρχιτεκτονικές δομές πρέπει να ανασχεδιαστούν από την αρχή, πράγμα που σημαίνει έρευνα και ανάπτυξη από την αρχή, δηλαδή κόπο, χρόνο και τεράστιο κόστος.

- Απώλεια θέσεων εργασίας. Αυτονόητο! Η ΤΝ θα αντικαταστήσει πολλές εργασίες, ιδίως κοπιώδεις εργασίες στην βιομηχανία, εργασίες που είναι επαναλαμβανόμενες και εργασίες που απαιτούν χρονοβόρα εξόρυξη στοιχείων, καταχώρηση, κατανομή και ατέλειωτες μαθηματικές πράξεις. Επίσης θα αντικαταστήσει εργατικό δυναμικό χαμηλής εξειδίκευσης, όπως φορτοεκφορτωτές και χειριστές μηχανών. Υπολογισμοί στις ΗΠΑ ανεβάζουν τις απώλειες μέχρι και 30% έως το 2030. το πρόβλημα έχει ήδη επηρεάσει τον ιατρικό και τον φαρμακευτικό κλάδο, ενώ ο νομικός και οικονομικός κλάδος έπονται (με πρώτη την λογιστική). Προτείνεται η επανεκπαίδευση του προσωπικού σε πιό απαιτητικές εργασίες.

- Ποδηγέτηση της κοινής γνώμης μέσω αλγορίθμων ΤΝ. Ήδη αυτό έχει ξεκινήσει στα Social Media με την χρήση των λεγόμενων trols. Τα trols είναι προγράμματα ΤΝ που επαναλαμβάνουν συνθήματα ή αφηγήματα σύμφωνα με τις επιθυμίες αυτού που τα ελέγχει. Είναι σχεδιασμένα ώστε να αποκρίνονται κατάλληλα σε παρατηρήσεις πραγματικών προσώπων με βάση συγκεκριμένα σενάρια. Η επανάληψη είναι μήτηρ μαθήσεως και τα συνθήματα των trols εγγράφονται στο μυαλό των αφηρημένων ή των ιδεοληπτικών και όχι μόνο! Η χρήση της ΤΝ για έλεγχο της κοινής γνώμης, είναι κάτι που ήδη χρησιμοποιείται για πολιτικούς και διαφημιστικούς σκοπούς! Το πράγμα έχει επιβαρυνθεί λόγω της ικανότητος της ΤΝ να μπορεί να τροποποιεί, ή και να κατασκευάζει φιλμάκια, φωτογραφίες και ομιλία και να παρουσιάζει “πειραγμένο” περιεχόμενο σαν πραγματικό. Κανείς πιά δεν μπορεί να είναι σίγουρος για το τί διαβάζει και η κατάσταση θα χειροτερέψει. Δεν έχει προταθεί συγκεκριμένο αντίμετρο.

- “Κοινωνική παρακολούθηση”. Είναι γνωστό ότι τα “social media” παρακολουθούν και καταγράφουν τις προτιμήσεις μας για διαφημιστικούς σκοπούς. Επίσης λέγεται ότι στην Κίνα ήδη χρησιμοποιείται η αναγνώριση προσώπου σε σχολεία και δημόσιους χώρους, “για σκοπούς ασφαλείας”, όπως εξηγούν οι “αρμόδιοι”, πράγμα που διευκολύνει την παρακολούθηση και καταγραφή των δραστηριοτήτων όλου του πληθυσμού και, μέσω της ΤΝ, των προτιμήσεών τους και των δραστηριοτήτων τους. Επιπλέον, είναι γεγονός ότι πολλά αστυνομικά τμήματα στις ΗΠΑ χρησιμοποιούν ή σκέπτονται να χρησιμοποιήσουν αλγορίθμους πρόβλεψης της παραβατικότητας, με παρόμοιο τρόπο. Αφού λοιπόν η παρακολούθηση ενός ολόκληρου πληθυσμού είναι τόσο “εύκολη” πιά, πώς μπορούμε να είμαστε σίγουροι για το πως θα χρησιμοποιηθεί από την ελίτ ενός τόπου; Στο μυαλό έρχεται το μυθιστόρημα του Orwell όπου η κυβέρνηση παρακολουθεί όλον τον πληθυσμό και προβαίνει σε ενέργειες “ευθυγράμμισης”, όσων ξεφεύγουν από τους κανόνες που έχουν τεθεί. Λύση στον ορίζοντα, δεν φαίνεται να υπάρχει. Βέβαια το πρόβλημα οι κυβερνήσεις να παίζουν τον ρόλο του “μεγάλου αδελφού” είναι το καλό σενάριο! Το ανατριχιαστικό σενάριο που μάλλον θα “παίξει” είναι ότι ΟΡΙΣΜΕΝΕΣ ΕΤΑΙΡΕΙΕΣ θα αναλάβουν αυτόν τον ρόλο. Το παιχνίδι δεν αφορά περισσότερα χρήματα, αλλά την ΠΑΓΚΟΣΜΙΑ ΚΥΡΙΑΡΧΙΑ από λίγους “ολιγάρχες”.

- Αδυναμία διαφύλαξης των προσωπικών στοιχείων. Το πρόβλημα διαπιστώθηκε πρώτα από τις μεγάλες εταιρείες και προκύπτει γιατί τα προσωπικά σας στοιχεία κυκλοφορούν στο διαδίκτυο για διάφορους λόγους. Ο βασικός λόγος είναι ότι διάφορες εταιρείες και οργανισμοί, ξεκινώντας από την ανάγκη της ασφάλειας αλλά και για πρακτικούς λόγους, προκειμένου να εγγράψουν κάποιον σαν συνδρομητή τους, ξεκινούν ζητώντας τα στοιχεία του. Η συγκέντρωση στοιχείων δεν είναι λοιπόν αρχικά ύποπτη, αλλά η ΤΝ ξεκινά να συλλέγει προσωπικά στοιχεία για να εκπαιδευτεί, αλλά και διότι έτσι την καθοδήγησαν. Ο τρόπος που θα χρησιμοποιηθεί στο τέλος αυτός ο τεράστιος όγκος δεδομένων από τον χειριστές της ΤΝ, είναι άγνωστος. Όσον αφορά στις εταιρείες το πρόβλημα μπορεί να αντιμετωπιστεί μερικώς με την κατάλληλη νομοθεσία. Αλλά τα στοιχεία θα φτάσουν τελικά και σε κυβερνητικές υπηρεσίες και ο πειρασμός να χρησιμοποιηθούν, μεγάλος!

- Ενίσχυση των πολωτικών τάσεων. Ένα απλό παράδειγμα για να καταλάβουμε τί συμβαίνει. Η UNESCO έχει υπολογίσει, ότι μόνο 100 από τις 7000 ομιλούμενες γλώσσες έχει χρησιμοποιηθεί για την εκπαίδευση των σημαντικών chatbots που κυκλοφορούν σήμερα. Επιπλέον, σήμερα στο διαδίκτυο το 90% του υλικού ανωτάτης εκπαίδευσης που κυκλοφορεί προέρχεται από την Βόρεια Αμερική και την Ενωμένη Ευρώπη και αυτό ενισχύει την παγκόσμια επιρροή των “Ευρωπαϊκών” γλωσσών. Μέρος του προβλήματος ξεκινά από το γεγονός ότι οι μηχανικοί ανάπτυξης της ΤΝ, δεν έχουν γενική μόρφωση, αλλά είναι εκπαιδευμένοι σε συγκεκριμένα πεδία, όπως μαθηματικά, ηλεκτρονικά και ανάλυση συστημάτων. Πολλά πράγματα τους διαφεύγουν και αυτό είναι ιδιαίτερα εμφανές στις περιπτώσεις που ένα chatbot υποδύεται ιστορικά πρόσωπα. Εάν οι εταιρείες και οι νομομαθείς δεν προσέξουν περισσότερο, κοινωνικές, ιστορικές και ρατσιστικές προκαταλήψεις θα ενισχυθούν.

- Ενίσχυση Κοινωνικών και οικονομικών ανισοτήτων. Είναι προέκταση του προηγουμένου προβλήματος. Μία ΤΝ, παραδείγματος χάριν, μπορεί να εκπαιδευτεί να αναλύει τις εκφράσεις του προσώπου και τον τόνο της φωνής, για να υπολογίζει τον χαρακτήρα ενός υποψηφίου προς πρόσληψη. Αλλά αυτό θα το κάνει βάσει επιστημονικών δεδομένων ή βάσει των προκαταλήψεων του χειριστού της; Σημειωτέον ότι οι λεγόμενες “κοινωνικές επιστήμες” δεν είναι απόλυτα αντικειμενικές και απαλλαγμένες από προκαταλήψεις αυτές καθεαυτές. Αυτή η διαδικασία πιθανόν να αφήνει κάποιους έξω από την αγορά εργασίας, ακριβώς γιατί οι προκαταλήψεις θα γίνουν μέρος ενός συστήματος που θα θεωρείται τεχνολογικό και άρα αντικειμενικό. Μεγάλος είναι ο κίνδυνος να δημιουργηθούν δύο μεγάλες κοινωνικές τάξεις : Μία πλούσια κάστα που θα μπορεί να ελέγχει μεγάλο μέρος του πληθυσμού, όχι μόνο μέσω του πλούτου της, αλλά και λόγω της δυνατότητάς της να έχει άμεση πρόσβαση στις υπηρεσίες της ΤΝ˙και μία δεύτερη κάστα φτωχοποιημένων, που δεν θα έχουν πρόσβαση, ούτε στην αγορά εργασίας, ούτε στις υπηρεσίες της ΤΝ. Πολλοί έχουν φτάσει στο σημείο να προτείνουν ένα νέο είδος “κοινωνικού συμβολαίου”.

- Ανεξέλεγκτη χρήση Αυτόνομων Όπλων. Ένας νέος ανταγωνισμός εξοπλισμών εμφανίζεται στον ορίζοντα. Το ερώτημα που θέτουν πολλοί είναι μήπως πρέπει να τον σταματήσουμε προτού ακόμη ξεκινήσει. Αυτό βέβαια φαντάζει ρομαντικό. Όποιος μπορεί, θα προχωρήσει στην παραγωγή όπλων με βάση την ΤΝ. Ένας νέος Ψυχρός πόλεμος εμφανίζεται προ των πυλών που θα βασίζεται όχι τόσο στην ισχύ των όπλων αλλά στην τεχνολογική υπεροχή. Το κακό αυτή την φορά είναι ότι θα διακινδυνεύουν κυρίως πολίτες, καθώς αυτά τα όπλα θα είναι εύκολα προσβάσιμα και εύχρηστα από εξτρεμιστικές ομάδες. Η εξάπλωση στην χρήση των drones δείχνει και την νοοτροπία : “Αν μπορούμε να το κάνουμε, ας το κάνουμε! Προβληματιζόμαστε μετά. Και αν μπορούμε να βγάλουμε λίγα χρήματα απ’ αυτό, τόσο το καλύτερο!”.

- Οικονομικές αναταραχές και κρίσεις. Ο κλάδος της οικονομίας ήταν ο πρώτος που υιοθέτησε την τεχνολογία της ΤΝ στις καθημερινές χρηματοοικονομικές και εμπορικές πράξεις. Αποτέλεσμα αυτού είναι ότι η οικονομία είναι η πλέον εκτεθειμένη στους κινδύνους που προέρχονται από την κακή χρήση της τεχνολογίας αυτής. Παρά το γεγονός ότι οι αλγόριθμοι δεν έχουν συναισθήματα και δεν κινούνται από απληστία, φόβο ή εμπιστοσύνη, παράλληλα δεν αντιλαμβάνονται συσχετίσεις, συνθήκες και το γενικότερο πλαίσιο. Συγχρόνως έχουν την ικανότητα να κάνουν χιλιάδες πράξεις σε δευτερόλεπτα υπολογίζοντας σε μικρό κέρδος ανά πράξη, που τελικά γίνεται μεγάλο με την επανάληψη. Όμως μια ξαφνική έκρηξη πράξεων μπορεί να προκαλέσει πανικό στους χρηματιστές που λειτουργούν έχοντας στο μυαλό τους μεγάλα κέρδη ή απώλειες από λίγες ή μία πράξη μόνο και να οδηγήσει σε μία υπερβολική αντίδραση που θα καταλήξει σε χρηματοπιστωτική κρίση. Τέτοιου είδους κρίση δεν είναι ένας απλός ανερμάτιστος φόβος, αλλά έχει καταγραφεί ήδη από το 2010. Στην προκειμένη περίπτωση εναπόκειται στις εταιρείες (κατασκευαστικές της ΤΝ αλλά και τις χρηματοπιστωτικές) να είναι βέβαιοι για την ορθή λειτουργία των αλγορίθμων, στη βάση ενός κοινού ηθικού κώδικα, προτού τους αφήσουν “ελεύθερους” να επιχειρήσουν στην αγορά.

- Απομείωση της σημασίας του ανθρώπου. Η υπερέκθεση, η υπερεμπιστοσύνη και η υπερχρήση των μηχανών ΤΝ, μπορεί να κάνει τους ανθρώπους να “τεμπελιάσουν” πνευματικά, λογικά και κοινωνικά. Οι άνθρωποι μπορεί να πάψουν να είναι κοινωνικοί, να έχουν φαντασία και δημιουργικότητα, να είναι δραστήριοι. Ίσως αυτός μάλιστα να είναι και ο μεγαλύτερος κίνδυνος από την χρήση της ΤΝ.

- Δημιουργία ανεξέλεγκτης ενσυνείδητης ΤΝ. Ο φόβος δημιουργίας μιας ανεξέλεγκτης ενσυνείδητης ΤΝ ταλαιπωρεί τον άνθρωπο από την εποχή που οι ηλεκτρονικοί υπολογιστές ήταν στα σπάργανα (Θυμηθείτε για παράδειγμα το φιλμ «2001: Η Οδύσσεια του Διαστήματος»). Μία τέτοια ΤΝ θα μπορούσε να αναπτύξει μεγάλη ευφυΐα ταχύτατα και θα ξέφευγε από τον έλεγχο του ανθρώπου με μεγάλη πιθανότητα να στρεφόταν εναντίον του. Κάποιοι μάλιστα, μεταξύ των οποίων και ο μηχανικός Geoffrey Hinton, υποστηρίζουν ότι το chatbot LaMDA, ήδη έχει ξεπεράσει το όριο και έχει αποκτήσει συνείδηση. Καθώς η Γενική ΤΝ βρίσκεται στους άμεσους στόχους κάποιων εταιρειών, οι ανησυχίες εντείνονται.

- Αύξηση της εγκληματικής δραστηριότητας. Ήδη αυτό δεν είναι ένας απλός φόβος, αλλά έχει συμβεί επανειλημμένα. Καθώς η τεχνολογία είναι ευρέως προσιτή, διάφοροι την χρησιμοποιούν για εγκληματικές πράξεις. Πρόσφατα ακούστηκε στις ελληνικές ειδήσεις ότι κάποια επιχειρηματίας έλαβε τηλεφώνημα που ανήκε στα τηλέφωνα της τραπέζης που η κυρία συνεργαζόταν και με την φωνή γνωστού της υπαλλήλου την έπεισε να μεταφέρει ένα ποσό σε κάποιον επίσης γνωστό της λογαριασμό. Αργότερα αποδείχτηκε ότι ούτε το συγκεκριμένο τηλέφωνο της τραπέζης χρησιμοποιήθηκε, ούτε ο υπάλληλος μπορούσε να συνομιλεί με την κυρία εκείνη την ώρα, καθώς βρισκόταν σε σύσκεψη, ούτε τα χρήματα έφτασαν στον λογαριασμό που η κυρία πίστευε ότι πιστώνονταν. Η εφευρετικότητα των εγκληματιών με την βοήθεια της ΤΝ, μπορεί να εκπλήξει και τον πιό έμπειρο στις χρηματοπιστωτικές πράξεις. Άλλοι έχουν δημιουργήσει πλαστά βίντεο παιδικής πορνογραφίας και βρέθηκαν στο απυρόβλητο καθώς το συγκεκριμένο έγκλημα δεν είχε προβλεφθεί. Αυτά τα παραδείγματα δείχνουν το πρόβλημα εν τη γενέσει του. Ούτε οι πολίτες ούτε οι δημόσιες υπηρεσίες μπορούν να προβλέψουν την επόμενη παραβατική κίνηση κάποιου εγκληματία.

- Γενικότερη κοινωνική και οικονομική αστάθεια. Η υπέρμετρη δραστηριότητα με την ΤΝ, μπορεί να δημιουργήσει υπερβολικά αποθέματα υλικών προς απόσυρση, τα οποία μπορούν να πουληθούν στην μαύρη αγορά και να πέσουν σε λάθος χέρια. Επίσης η υπερβολική χρήση αναμένεται να δημιουργήσει ελλείψεις υλικών και χημικών ουσιών στην αγορά και κατά συνέπεια, εκρηκτική αύξηση τιμών (Το παράδοξο του Jevons). Ο μεγαλύτερος κίνδυνος προβλέπεται ότι θα επηρεάσει την αγορά ηλεκτρικής ισχύος.

Συμπερασματικά, η Τεχνητή Νοημοσύνη,

- Ήρθε και θα παραμείνει μαζί μας στο μέλλον. Η Ελλάδα “έχει χάσει το τρένο” της έρευνας και της ανάπτυξης. Τουλάχιστον ας προσπαθήσει να εξοικειωθεί με την αποδοτική και αποτελεσματική χρήση των συστημάτων!

- Θα μας βοηθήσει σε πολλές επαναλαμβανόμενες νοητικές, κοπιώδεις και βαρετές για τους ανθρώπους, εργασίες. Εργασίες που έχουν ανάγκη από βιομηχανικούς εργάτες, την εξόρυξη στοιχείων, την καταχώρηση στοιχείων, τις μαθηματικές πράξεις, την Στατιστική Ανάλυση, τον υπολογισμό τάσεων, την αναγνώριση και παρακολούθηση αντικειμένων και ανθρώπων, την βελτίωση εικόνων και βίντεο, την αυτόματη μετάφραση, τις πολεμικές επιχειρήσεις χωρίς την συμμετοχή ανθρώπων, κλπ.

- Δεν θα μπορέσει να αντικαταστήσει τους ανθρώπους παντού, αφού δεν μπορεί να εκτελέσει πολλές παράλληλες εργασίες και δεν έχει αντίληψη του κόσμου, φαντασία, δημιουργικότητα, έννοια ηθικής, συναίσθημα, κοινωνική αντίληψη, ενσυναίσθηση, ένστικτο αυτοσυντήρησης και συνείδηση. Σε πολλές εργασίες θα χρειαστεί να παρακολουθείται και να ελέγχεται από κάποιον χειριστή.

- Ακολουθείται από πραγματικούς και πιθανούς κινδύνους για τους οποίους πολλοί από τους ειδικούς μας έχουν προειδοποιήσει, αλλά το τελικό συμπέρασμα είναι ότι δεν κινδυνεύουμε από την ΤΝ αυτήν καθεαυτήν, αλλά από τον τρόπο που αυτή θα χρησιμοποιηθεί από τους ανθρώπους, είτε από μεμονωμένα άτομα, είτε από ομάδες, κυβερνήσεις, οργανισμούς και κυρίως εταιρείες. Η “δημοκρατία”, ακόμη και αυτή η κουτσή που έχουμε σήμερα, κινδυνεύει να εκλείψει. Από την άλλη, πολλοί εργασιακοί κλάδοι θα εξαφανιστούν τελείως, ενώ μεγάλο μέρος του πληθυσμού θα χάσει οικονομικούς πόρους, αλλά και την δημιουργικότητά του και το ενδιαφέρον του για την ζωή.

Τα προβλήματα αυτά χρειάζονται και την κατάλληλη αντιμετώπιση.

- Για να αντιμετωπίσουμε τις νέες συνθήκες, κατάλληλη ανασχεδίαση των κυκλωμάτων θα απαιτηθεί, αλλά και νομοθετικές ρυθμίσεις, όμως η ταχύτητα με την οποία πραγματοποιούνται οι αλλαγές που η ΤΝ επιφέρει στην κοινωνία, είναι τόσο ταχείες που δεν επιτρέπει την αδράνεια.

- Η προσαρμογή των ίδιων των ανθρώπων και των κοινωνιών στις νέες συνθήκες, είναι απαραίτητη. Χρειάζεται επανεκπαίδευση για την εύρεση νέων εργασιών, αλλαγή των εκπαιδευτικών στόχων, προσωπική και κοινωνική επαγρύπνηση, προσήλωση στην κοινωνική ηθική και, ενδεχομένως, ένα νέο “κοινωνικό συμβόλαιο”, προτού ανακύψουν σοβαρές κοινωνικές αναστατώσεις.

Δημήτριος Κατελούζος

Υπτχος εα, απόφοιτος ΣΜΑ

19 Μαρτίου 2025

(Αναρτήθηκε για πρώτη φορά στην ιστοσελίδα https://coeacropolis.gr/ στα μέσα Φεβρουαρίου 2025)

Βιβλιογραφία

1. Yudkowsky, Eliezer, 2008, από το Machine Intelligence Research Institute. “Artificial Intelligence as a Positive and Negative Factor in Global Risk”. Στόχος του συγγράμματος η απομυθοποίηση και αποαγιοποίηση της ΤΝ και η προτροπή να την χρησιμοποιήσουμε σαν μία απαιτητική τέχνη.

2. “Promoting the Use of Trustworthy Artificial Intelligence in the Federal Government”, Executive Order 13960 of December 3, 2020.

3. “Artificial Intelligence: A Modern Approach” university textbook on artificial intelligence (AI), by Stuart J. Russell and Peter Norvig. 1995.

4. “An Introduction to Game Theory” 4η Έκδοση, του Eric Rasmusen, αρχική έκδοση Φεβρουάριος 2000.

5. “Fundamentals of Data Structures” των Ellis Horowitz και Sartaj Sahni, Οκτώβριος 1981.

6. “Attention is All You Need” διαφόρων συγγραφέων της Google (από τμήματα Brain και Research) και University of Toronto, Αύγουστος 2013.

7. “Massive exploration of neural machine translation architectures”, των Denny Britz, Anna Goldie, Minh-Thang Luong, and Quoc V. Le., 2017.

8. “Deep residual learning for image recognition” των Kaiming He, Xiangyu Zhang, Shaoqing Ren, and Jian Sun, Proceedings of the IEEE Conference on Computer Vision and Pattern

Recognition, 2016.

9. “Continual Lifelong Learning with Neural Networks: A Review” των German I. Parisi, Ronald Kemker, Jose L., Christopher Kanan, Stefan Wermter, Chester F. Carlson, 11Φεβρουαρίου 2019.

10. “Qualia: The Knowledge Argument”, Nida-Rümelin, Martine and Donnchadh O Conaill, 1 Μαρτίου 2024, https://plato.stanford.edu/cgi-bin/encyclopedia/archinfo.cgi?entry=qualia-knowledge

11. “Risks of Artificial Intelligence”, https://builtin.com/artificial-intelligence/risks-of-artificial-intelligence